La Corte Suprema de Brasil resolvió este jueves que las plataformas de redes sociales pueden ser consideradas legalmente responsables por publicaciones de terceros que contengan contenido ilegal, si no actúan para eliminarlas tras una solicitud directa. Esta determinación introduce un cambio significativo en el marco jurídico que regulaba hasta ahora la actuación de las empresas tecnológicas.

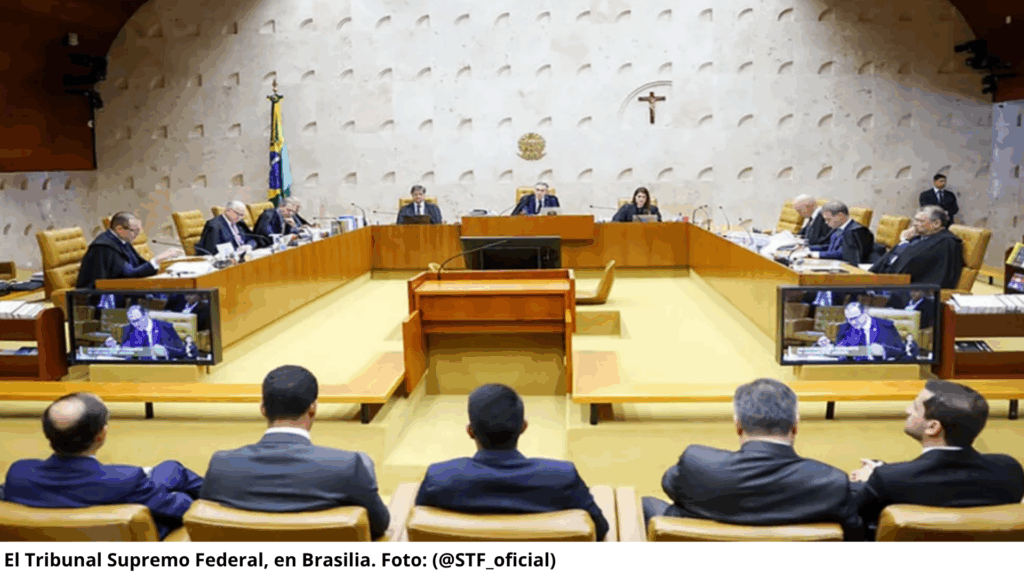

Con ocho votos a favor y tres en contra, el Supremo Tribunal Federal (STF) adoptó una interpretación más estricta en torno al rol de las redes sociales en la moderación de contenido. Según la mayoría, no será necesaria una orden judicial para exigir la retirada de contenidos ilícitos si estos fueron previamente denunciados por quienes se consideran afectados.

Entre los ejemplos citados por el tribunal están publicaciones con pornografía infantil, incitación al terrorismo o amenazas al orden democrático. En esos casos, una notificación extrajudicial será suficiente para activar la responsabilidad de la plataforma, en caso de omisión.

El presidente del Supremo, Luís Roberto Barroso, sostuvo en su voto que la responsabilidad de las plataformas no es automática, pero sí puede configurarse ante un “fallo sistémico” al no actuar frente a contenidos manifiestamente delictivos. Barroso, sin embargo, defendió mantener el requerimiento de una orden judicial para casos vinculados a delitos contra el honor, como la difamación o la calumnia.

Por otro lado, tres magistrados votaron en contra de esta ampliación, argumentando que la medida puede suponer una amenaza a la libertad de expresión. Desde esta postura, solo debería haber sanción para las plataformas si, luego de una orden judicial, estas no proceden a eliminar el contenido señalado.

El fallo también invalidó parcialmente un artículo del Marco Civil de Internet, la ley brasileña que desde 2014 regulaba el comportamiento de las plataformas digitales. Para la mayoría del tribunal, esta normativa resultó insuficiente ante el crecimiento de la desinformación y el uso masivo de redes sociales para difundir discursos de odio o llamados antidemocráticos.

Uno de los episodios que marcó el debate fue el asalto a las sedes de los tres poderes del Estado brasileño en enero de 2023. En ese entonces, redes sociales fueron utilizadas para convocar protestas masivas de seguidores del expresidente Jair Bolsonaro, lo que derivó en actos violentos y en la posterior condena de varios participantes por intento de golpe de Estado.

El STF consideró que la rápida propagación de estos mensajes y la inacción de ciertas plataformas fueron evidencia de las debilidades del marco legal anterior. El tribunal remarcó que las redes no pueden ser zonas libres de regulación cuando se trata de proteger la democracia y los derechos fundamentales.

El conflicto entre el poder judicial brasileño y las grandes plataformas tecnológicas ya había tenido episodios notables, como el enfrentamiento entre el Supremo y Elon Musk, dueño de la red social X (antes Twitter). El empresario se negó inicialmente a cumplir órdenes para retirar contenido, pero finalmente cedió luego de que la Justicia brasileña ordenara el bloqueo de cuentas bancarias de sus empresas en el país.

La medida del STF brasileño se inscribe en una tendencia global que exige mayor responsabilidad a las plataformas digitales por los contenidos que alojan. En Europa, iniciativas como la Ley de Servicios Digitales (DSA) ya apuntan en esa dirección, mientras en Estados Unidos el debate continúa dividido por las implicaciones constitucionales.

Para el Supremo brasileño, la resolución busca garantizar un entorno digital más seguro, sin que ello implique censura previa o control abusivo. El mensaje parece claro: las plataformas no pueden eludir su responsabilidad cuando están en juego derechos fundamentales o la estabilidad institucional.